Stable Diffusion 2.0 สร้างภาพจากภาพต้นฉบับได้หลากหลายขึ้น ทำภาพความละเอียดสูงได้

Stability AI เปิดตัวโมเดลปัญญาประดิษฐ์ Stable Diffusion 2.0 โดยฝึกจากชุดข้อมูล LAION-5B ที่ลบภาพโป๊ออกหมดแล้ว ตัวโมเดลสามารถสร้างภาพได้ขนาด 512×512 พิกเซลหรือ 768×768 พิกเซลพร้อมกับตัวเพิ่มความละเอียดภาพให้เป็นระดับ 2048×2048 พิกเซลหรือสูงกว่าได้

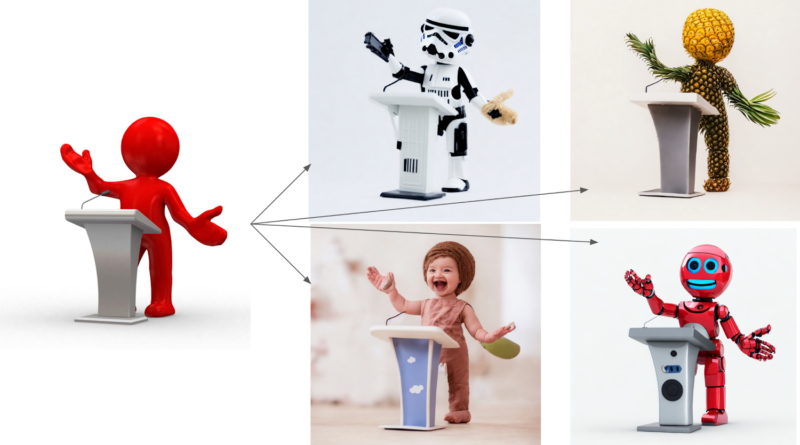

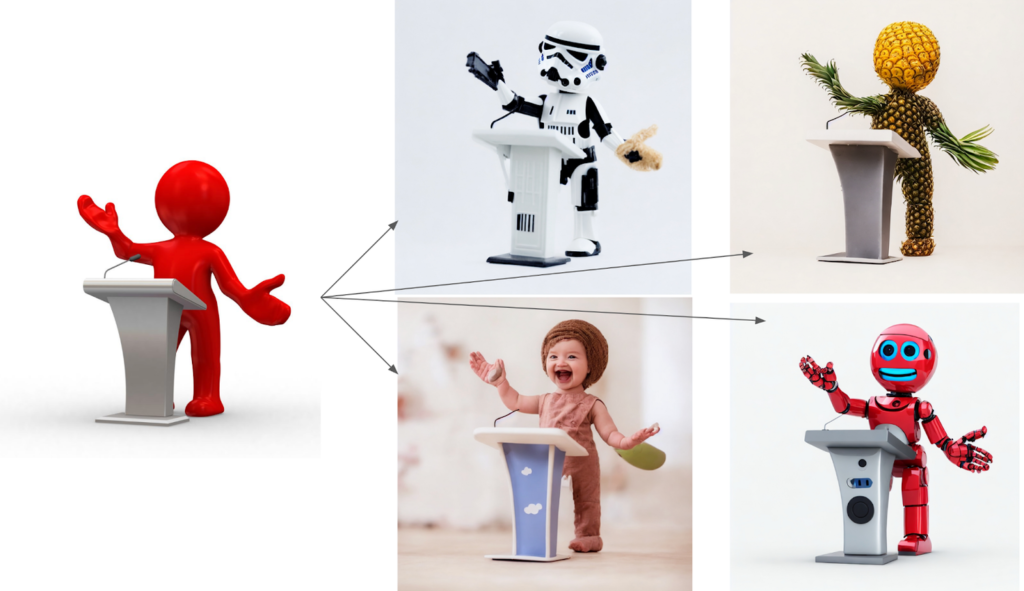

ฟีเจอร์สำคัญที่เพิ่มมาคือการสร้างภาพแบบ Depth-to-Image ที่สร้างภาพจากภาพต้นฉบับ แล้วใส่ขอความแนะนำเพิ่มเติม และโหมดปรับจากภาพเดิม (inpainting)

โมเดล Stable Diffusion 2.0 ยังคงรันได้ในชิปกราฟิกตัวเดียว และจะเปิดให้ใช้งานในแพลตฟอร์มออนนไลน์ต่อไป

Stable Diffusion V1ดั้งเดิมที่นําโดยCompVisได้เปลี่ยนลักษณะของโมเดล AI แบบโอเพนซอร์สและเกิดโมเดลและนวัตกรรมอื่น ๆ อีกหลายร้อยรุ่นทั่วโลก

Robin Rombach (Stability AI) และ Patrick Esser (Runway ML) จากCompVis Group ที่ LMU MunichนําโดยProf. Dr. Björn Ommer เป็นผู้นําการเปิดตัว Stable Diffusion V1

พวกเขาสร้างจากการทํางานก่อนหน้าของห้องปฏิบัติการด้วยโมเดลการแพร่กระจายแฝงและได้รับการสนับสนุนที่สําคัญจากLAIONและEleuther AI

Stable Diffusion 2.0 ปรับปรุงคุณสมบัติที่สําคัญมากมายเมื่อเทียบกับรุ่น V1 ดั้งเดิม

โมเดลการแพร่กระจายความลึกถึงภาพ

โมเดลการแพร่กระจายที่เสถียรแบบนําทางความลึกใหม่ของเราที่เรียกว่าdepth2img ขยายคุณสมบัติภาพต่อภาพก่อนหน้านี้จาก V1 ด้วยความเป็นไปได้ใหม่เอี่ยมสําหรับการใช้งานที่สร้างสรรค์ Depth2imgอนุมานความลึกของภาพอินพุต (โดยใช้แบบจําลองที่มีอยู่) จากนั้นสร้างภาพใหม่โดยใช้ทั้งข้อความและข้อมูลความลึก

ที่มา: stability.ai